Yann LeCun เป็นนักวิจัยด้าน AI ชื่อดังของวงการ เขาเป็นคนฝรั่งเศส ที่บุกเบิกเรื่อง computer vision และ convolutional neural networks (CNN) มายาวนาน

คนที่เริ่มต้นศึกษาเรื่อง AI, machine learning, deep learning ยุคใหม่ อาจเคยต้องฝึกให้โมเดลของเราเทรนภาพ 0-9 ที่เขียนด้วยลายมือ แล้วนำโมเดลไปแยกแยะลายมือในอนาคต ตัวอย่างนี้เทียบได้กับ Hello World ของโลก AI

ตัวไฟล์ภาพลายมือ 0-9 ที่ใช้เทรนกัน มีชื่อเรียกว่า MNIST dataset ซึ่งพัฒนาและรวบรวมโดย LeCun คนนี้เอง

ประวัติการทำงานของ LeCun คือจบปริญญาเอกจากมหาวิทยาลัย Sorbonne ในปารีส แล้วมาทำงานกับ AT&T Bell Labs จนถึงปี 1996 จากนั้นย้ายมาอยู่วงการวิชาการ เป็นอาจารย์ที่ New York University (NYU) และปี 2013 ย้ายไปเป็นหัวหน้านักวิจัยด้าน AI ของ Facebook/Meta จนถึงปัจจุบัน (ประวัติบน LinkedIn)

LeCun มีผลงานวิชาการมากมาย จำนวน citation ใน Google Scholar คือเกือบ 3 แสนรายการ คำว่า Deep Learning ก็โด่งดังขึ้นมาจากเปเปอร์ของเขาในปี 2015 ถึงแม้เขาไม่ใช่คนคิดคำนี้ขึ้นมาเป็นคนแรก แต่ก็ถือเป็นบุคคลสำคัญของวงการ AI ของโลก โดยเฉพาะสาย Deep Learning

ทีมผู้เขียนเปเปอร์ฉบับปี 2015 คือ LeCun ร่วม Yoshua Bengio และ Geoffrey Hinton (เป็นอาจารย์ postdoc ของ LeCun) ได้รับรางวัล Turing Award ซึ่งเทียบได้กับรางวัลโนเบลของสาขาวิชาคอมพิวเตอร์ เมื่อปี 2018 (รายชื่อผู้ที่เคยได้รางวัลทั้งหมด)

ทั้งหมดทั้งปวงที่กล่าวมา เพื่อจะบอกว่า LeCun ถือเป็นหนึ่งใน godfather คนสำคัญของวงการ AI โลก เกียรติประวัติเพียบพร้อมทุกด้าน

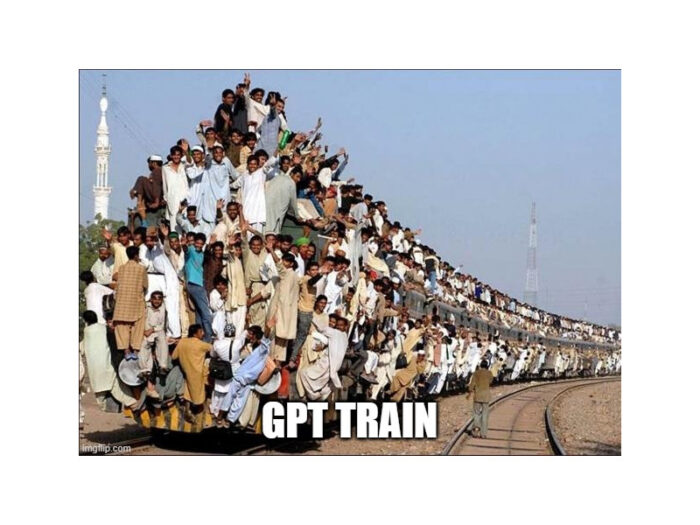

แต่หลังจากโลกเข้าสู่ยุค “ตื่นทอง AI” ในช่วงปลายปี 2022 เป็นต้นมา จากการเปิดตัว ChatGPT ของ OpenAI ทำให้เกิดการแข่งขันในหมู่บริษัทยักษ์ใหญ่ ไม่ว่าจะเป็น Microsoft + OpenAI vs Google หรือแม้แต่ Meta ที่ LeCun ทำงานอยู่ก็ตาม

LeCun เป็นนักวิจัย-นักวิชาการคนสำคัญ ที่ออกมาวิจารณ์ ชี้แจง ให้ข้อมูลว่าข้อจำกัดของ GPT ในทางเทคนิคมันคืออะไร (เพราะแกรู้จริงเรื่องนี้)

แต่ตามภาษิตโบราณว่าเอาไว้ “น้ำเชี่ยวอย่าไปขวางเรือ” ในยุคที่มหาชนกำลังตื่นเต้นกับ AI กันอย่างบ้าคลั่ง (เราน่าจะอยู่ในระดับที่ใช้คำนี้ได้แล้ว) การออกมาวิจารณ์ของ LeCun ย่อมนำไปสู่สิ่งที่คาดเดากันได้ไม่ยากว่า “ทัวร์ลง”

อย่างไรก็ตาม ผมคิดว่าความเห็นของ LeCun นั้นเที่ยงตรง เฉียบคม มองเห็นสภาพความเป็นจริง และให้มุมมองเรื่องทางเทคนิคได้เป็นอย่างดี จึงขอแสดงตัวอย่างเป็นทางการในที่นี้ว่า เห็นด้วยกับความเห็นของ LeCun ทุกประการ

และอยากแนะนำให้ทุกคนที่สนใจเรื่อง AI ในปี 2023 ควรตามอ่านความเห็นของ Lecun ในทวิตเตอร์กันอย่างจริงจัง (แต่พี่ทำงานอยู่ Meta นะ)

My unwavering opinion on current (auto-regressive) LLMs

1. They are useful as writing aids.

2. They are "reactive" & don't plan nor reason.

3. They make stuff up or retrieve stuff approximately.

4. That can be mitigated but not fixed by human feedback.

5. Better systems will come— Yann LeCun (@ylecun) February 13, 2023

13. Why do LLMs appear much better at generating code than generating general text?

Because, unlike the real world, the universe that a program manipulates (the state of the variables) is limited, discrete, deterministic, and fully observable.

The real world is none of that.— Yann LeCun (@ylecun) February 13, 2023

สรุปความเห็นของ LeCun ต่อยุคสมัยแห่ง ChatGPT

- Large Language Model (LLM) ชื่อมันก็บอกว่าเป็น language model คือทำความเข้าใจภาษา

- โมเดล LLM ทั้งหลายจึงเก่งเรื่องภาษา แต่งคำ แต่งเรื่อง คีย์เวิร์ดสำคัญคือ “แต่งเรื่อง” (make stuff up)

- แต่มันไม่เก่งเรื่องการให้เหตุผล (reasoning) ซึ่งอาจมีในโมเดลประเภทอื่นที่ไม่ใช่ LLM

- ดังนั้น มันเป็นโมเดลที่ “ปั้นเรื่อง” เก่งมาก ดูน่าเชื่อถือ แต่อาจไม่เป็นความจริง

- เราควรมอง LLM เป็นตัวช่วยเขียนเรื่อง (writing aid) แต่ไม่ใช่ตัวตอบคำถามที่หวังจะบอกความจริงของจักรวาลได้

- LLM ช่วยเขียนโค้ดโปรแกรมมิ่งได้ดี (e.g. GitHub Copilot) เพราะโปรแกรมมิ่งคือ “ภาษา” ที่มีความเป็นไปได้จำกัดกว่าภาษามนุษย์มาก มีโครงสร้าง กฎระเบียบชัดเจนกว่า

- ในอนาคตเราจะได้เห็นโมเดลอื่นๆ ที่เก่งขึ้นกว่านี้อีกเรื่อยๆ แต่ยังไม่ใช่ตอนนี้

ทั้งนี้ต้องบอกว่าภาพรวมความเห็น LeCun คือ pro-AI นะครับ เพียงแต่แกวิจารณ์ตัวโมเดล GPT เพียงอย่างเดียวว่าอย่าเพิ่งตื่นเต้นกันไปมาก อย่าเพิ่งอวย OpenAI กันมาก เพราะจริงๆ แล้วมีอย่างอื่นที่น่าตื่นเต้นกว่าในสายงานวิจัยรออยู่เท่านั้นเอง

Good article on LLMs at Forbes.

The media are starting to agree with my much-criticized statements about LLMs.

"LLMs as they exist today will never replace Google Search. Why not? In short, because today’s LLMs make stuff up."https://t.co/Cngp2Zyisq

— Yann LeCun (@ylecun) February 12, 2023

Before we reach Human-Level AI (HLAI), we will have to reach Cat-Level & Dog-Level AI.

We are nowhere near that.

We are still missing something big.

LLM's linguistic abilities notwithstanding.

A house cat has way more common sense and understanding of the world than any LLM.— Yann LeCun (@ylecun) February 5, 2023

หมายเหตุ: เขียนมาจนจบแล้วเพิ่งเห็นว่า Forbes มีบทความเรื่องเดียวกันเลย

Forbes

Forbes